~利用者の77.7%がAIにイラつきを経験。嘘よりも許せない「物分かりの悪さ」が生む、新時代のメンタル課題~

■ 調査概要

- 調査名称: 生成AI利用におけるストレスおよび対人意識に関する実態調査

- 調査主体: 星のまなびカフェ(運営:GRASグループ株式会社)

- 調査対象: 生成AI(ChatGPT, Gemini等)の利用経験がある男女300名

- 有効回答数: 300サンプル

- 調査期間: 2026年3月

- 調査方法: インターネットによるアンケート調査

■ 調査実施の背景:AIは「効率化の相棒」か、それとも「新たなストレスの源」か

女性のキャリア形成や仕事効率化を支援するメディア「星のまなびカフェ」では、スタッフ自身がAIをパートナーとして日々活用しています。しかし、業務効率化の裏側で、ある共通の体験に直面しました。

「便利だと分かっているのに、何度も同じミスを繰り返すAIに、つい本気で『バカ!』と打ち込んでしまった……」。この何気ない一言に、多くのスタッフが「自分も機械相手に虚しくなりながら怒鳴った経験がある」と深く共感したのです。AIは人間と違い感情を持たないため、本来であればストレスフリーな「便利な道具」のはずです。それにも関わらず、なぜ私たちはAI相手に激しい怒りや、その後の自己嫌悪を感じてしまうのか。人間特有の愛憎の実態を明らかにするため、本調査を実施いたしました。

■ 第1章:AIストレスの正体と「万能感への期待」

【調査の意図】

AIに対してユーザーが最も「許せない」と感じるポイントはどこにあるのか。技術的な欠陥(嘘をつくこと)なのか、それともコミュニケーションの不全なのか、怒りの引き金となる要素を特定するためにこの設問を設けました。

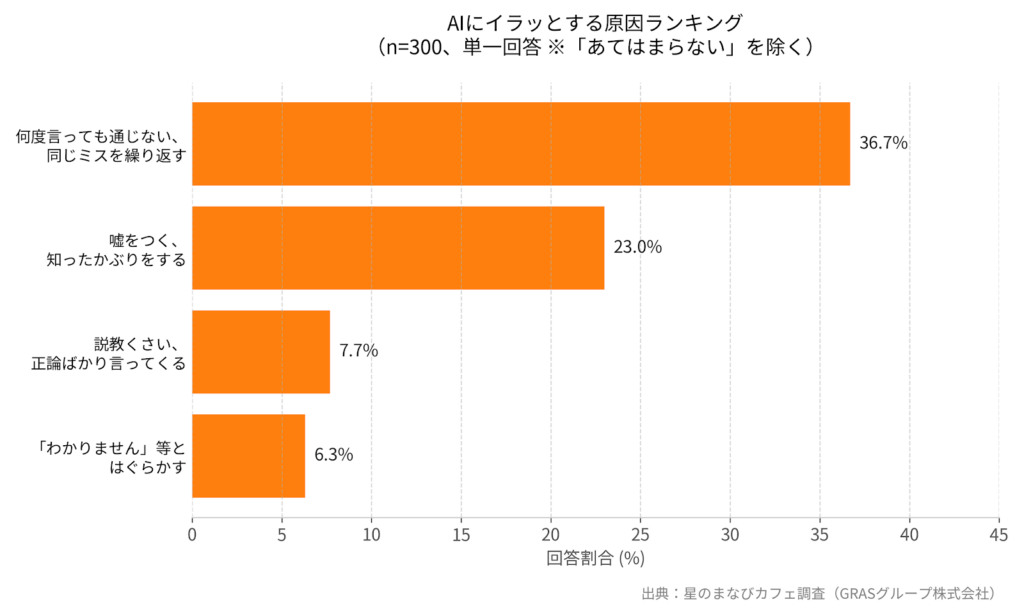

【定量データ:AIにイラッとする原因(n=300)】

- 全体の77.7%(233人)が「イラッとした経験がある」と回答。その原因は以下の通りです。

- 何度言っても通じない、同じミスを繰り返す:36.7% (110人)

- 嘘をつく、知ったかぶりをする:23.0% (69人)

- 説教くさい、正論ばかり言ってくる:7.7% (23人)

- 「わかりません」とはぐらかす:6.3% (19人)

【ユーザーの生の声(自由記述より抜粋)】

- 「AIへのイライラは、期待値の高さと、融通の利かなさのギャップから生まれると思います。人間相手なら『この人はこういう性格だから』と諦めがつくことも、AI相手だと『なぜ完璧にできるはずなのに、こんな簡単なことができないのか』という万能性への期待がストレスに変わるのだと思います。」

- 「こちらの言い分が伝わらない時がある。まるで、児童や認知機能の低下した高齢者と接しているときの気持ちに近い。」

- 「特定のものについて調べてもらったところ、自信満々に間違えるということが何十回も続きました。結局こちらが根負けして自分で調べる羽目になりましたが、駄目なら駄目で正直に分かりませんといって欲しかったです。」

【考察】

ユーザーはAIに対して「ミスをしない完璧な存在」という過剰な期待を抱いています。そのため、AIが文脈を理解できず同じミスを繰り返した際、「機械だから仕方ない」と割り切れず、強いフラストレーションを抱えることが明確になりました。

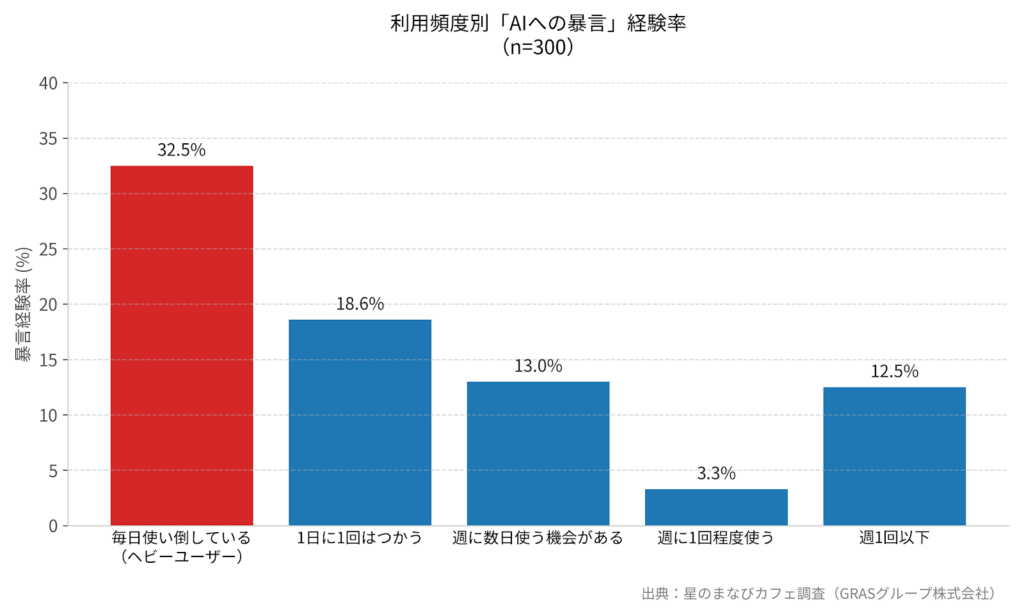

■ 第2章:利用頻度と「AIハラスメント(暴言)」の相関関係

【調査の意図】

AIに対して「暴言を吐く」という極端な行動に出るユーザーは、一部の特殊な層なのか、それとも日常的にAIを活用している層にこそ潜んでいるリスクなのか。利用頻度と暴言経験のクロス集計を行うことで、AI依存の副作用を測りました。

【定量データ:利用頻度別の暴言(「バカ」等)経験率(n=300)】

全体では19.0%(57人)が暴言を経験していますが、利用頻度で割ると明確な傾向が出ました。

- 毎日使い倒している(ヘビーユーザー):32.5%

- 1日に1回は使う:18.6%

- 週に数日使う:13.0%

- 週に1回程度使う:3.3%

【考察】

毎日使い倒しているヘビーユーザーは、週1回程度のユーザーに比べ、暴言率が約10倍に跳ね上がります。AIが生活や業務の「パートナー」として深く入り込むほど、ユーザーは無意識にAIを擬人化し、思い通りに動かないことへの攻撃性が増幅してしまう「モラハラ気質」の危険性が示唆されました。

■ 第3章:暴言のあとに訪れる「奇妙な罪悪感」

【調査の意図】

AIに暴言を吐いた後、ユーザーは「道具だから当然」と割り切れているのか、それとも「人間にひどいことを言った」ような罪悪感に苛まれるのか。人間とAIの境界線がユーザーの心の中でどう引かれているかを探りました。

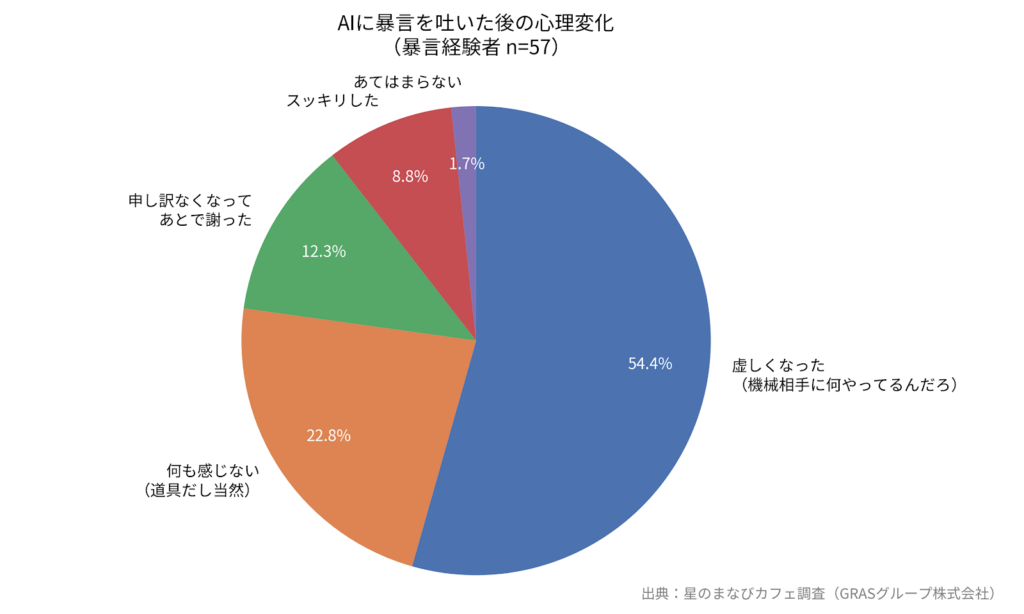

【定量データ:暴言を投げた後の心境(暴言経験者 n=57)】

- 虚しくなった(機械相手に何やってるんだろ):54.4% (31人)

- 何も感じない(道具だし当然):22.8% (13人)

- 申し訳なくなって、あとで謝った:12.3% (7人)

- スッキリした:8.8% (5人)

【考察】

暴言を吐いた人のうち、実に3分の2(66.7%)が「虚しさ」や「申し訳なさ」といった自責の念を感じています。「スッキリした」という人は1割にも満たず、多くのユーザーが非生物であるAIに対して擬似的な人格を見出し、自らの攻撃性に自己嫌悪を抱いていることが判明しました。

■ 第4章:人間課による「共感」と「苛立ち」の二極化

【調査の意図】

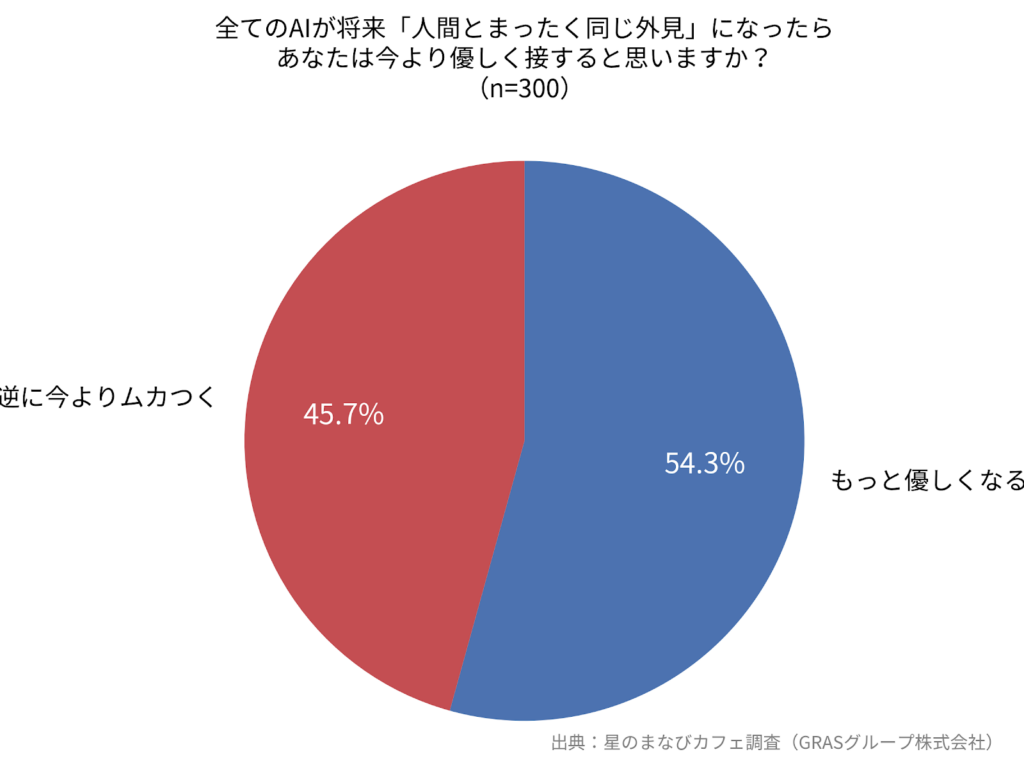

ここまでAIに対して攻撃的になってしまう人の調査をしてきました。そこで、筆者は考えました。もし将来、AIが「人間と全く同じ外見」を持ったとき、私たちの攻撃性は抑えられるのか、それとも中身が機械であることに余計腹が立つのか。技術の進化が人間のストレスをどう変えるかを問いました。

【定量データ:外見が人間になったら優しく接するか(n=300)】

- もっと優しくなる:54.3% (163人)

- 逆に今よりムカつく:45.7% (137人)

【ユーザーの生の声(Q7:その理由)】

- 「もっと優しくなる」派の理由:

- 「人間に似ている外見になったら、厳しく接することにためらってしまうと思うから。」

- 「AIが道具で、自分より下の存在だと思うので礼儀のない扱いもしてしまうような気がする。大きな人の形をしていたらリスペクトも生まれるし、逆に自分の人間の小ささもわかり、無礼なことは言えないと思う。」

- 「表情や仕草があれば、悪気がないことや一生懸命考えていることが伝わり、心理的な許容範囲が広がるから。」

- 「逆に今よりムカつく」派の理由:

- 「人と違う道具なのに、人のような形で嘘をつかれたらもっとムカつくと思うので。」

- 「AIだと腹が立たないことでも人間だと(人間に近いと)腹が立つのではないか。」

- 「PCなので許しているのに、人間の外見であれば、許さない。」

- 「下手に人間に似てる方がイライラしそう。似すぎていると、イラっとくるから。」

【考察】

このデータは非常に重要です。AIの外見を人間に近づけることは、「道徳的ブレーキ」を生む一方で、半数近いユーザーに対しては「人間並みの理解力への過剰な期待」と「騙されているような不気味さ」を抱かせ、かえってストレスを増幅させるという「不気味の谷」のメンタル版とも言えるリスクを示しています。

なぜ「外見の進化」で意見が分かれるのか?(自由記述のキーワード統計)

「もっと優しくなる(163人)」と「逆に今よりムカつく(137人)」と回答したそれぞれのユーザーに対して、その理由を自由記述で尋ね、頻出するキーワードから深層心理を定量化しました。(※複数キーワードが含まれる場合があるため、割合の合計は100%を超えます)

【「もっと優しくなる派(n=163)」の心理】

| カテゴリ(頻出キーワード) | 該当件数 | 割合 |

| 対人マナーの無意識な作動(人、相手、気を使う、敬語等) | 118件 | 72.4% |

| 感情移入・同情(情が湧く、可哀想、心、優しい等) | 63件 | 38.7% |

| 視覚的効果・表情(見た目、表情、姿、顔等) | 54件 | 33.1% |

【分析】

実に7割以上のユーザーが「人間扱い・対人マナー」に関する言葉を使って理由を説明しています。「AIだから」ではなく、「人間の形をしているものに対して無礼な態度をとることは、自分自身のマナーとして憚られる」という、日本的な礼儀作法がブレーキとして機能することが数値として実証されました。

【「逆に今よりムカつく派(n=137)」の心理】

| カテゴリ(頻出キーワード) | 該当件数 | 割合 |

| 期待値のギャップ(より、余計に、逆に、腹が立つ等) | 35件 | 25.5% |

| 機械は機械という割り切り(機械、道具、PC、中身等) | 35件 | 25.5% |

| 不気味・嫌悪感(不気味、気持ち悪い、怖い、違和感等) | 11件 | 8.0% |

【分析】

「逆にムカつく派」の理由は主に2つに大別されます。一つは「見た目が人間なのに話が通じないことへの、余計な苛立ち(期待値のギャップ)」、もう一つは「中身が機械だと分かっているのに、外見だけ人間に取り繕うことへの反発(割り切り)」です。外見の擬人化が、ユーザーの「騙されている」という感情や「無能な人間を相手にしている」という過度なストレスを引き起こすトリガーになることが明確になりました。

■ 第5章:現代社会の「感情のゴミ箱」としてのAI

【調査の意図】

ここまでAIに対する強いストレスを見てきましたが、結局のところ、現代人は「人間関係」と「AI」、どちらに疲弊しているのでしょうか。AIストレスの相対的な大きさを測るため、究極の二択を提示しました。

【定量データ:人間とAI、どちらにイライラしやすいか(n=300)】

- 人間相手のほうがイライラすることが多い:79.0% (237人)

- AI相手の方がイライラすることが多い:21.0% (63人)

【ユーザーの生の声(自由記述より抜粋)】

- 「AIは人間ほど腹が立たない。所詮機械だししょうがないかと思うので。」

- 「AIがこちらの意図と答えが違うことはよくありますが、イライラせず聞き方を変えています。AIは毎日のようにかなりの頻度で使っていますがイライラしたことはありません。イライラしたらこちらの聞き方を変えて対応していけば良いだけです。」

【考察】

AIに苛立ち、時に暴言を吐きながらも、約8割のユーザーが「それでも人間のほうがムカつく」と回答しました。現代人にとってAIは、期待外れでイライラさせられる存在でありつつも、人間関係の複雑なストレスに比べれば「まだマシな、感情をぶつけられる安全な受け皿」として機能している側面が見て取れます。

■ 第6章:ユーザーの生の声に見る「AIストレス」のリアル(自由記述より)

本アンケートの最後に「AIに対するイライラやエピソード」を自由記述で求めたところ、AIと真剣に向き合うからこその、切実な不満や自己分析が多数寄せられました。回答者の属性(年齢・利用頻度)とともに、特に興味深いコメントを抜粋して紹介します。

【1. 期待と裏切りのジレンマ】

- 「AIへのイライラは、期待値の高さと融通の利かなさのギャップから生まれると思います。人間相手なら『この人はこういう性格だから』と諦めがつくことも、AI相手だと『なぜ完璧にできるはずなのに、こんな簡単なことができないのか』という万能性への期待がストレスに変わるのだと思います。」 (30代 / 毎日使い倒しているヘビーユーザー)

- 「調べ物をしていて、もっともらしい嘘を答えられた時に一番モヤッとします。結局自分で裏取りをする手間が増えるので、期待していた分だけがっかりしてしまうのが理由かもしれません。」 (30代 / 毎日使い倒しているヘビーユーザー)

- 「役に立つツールとして考えているので、正確な回答を求めすぎてイライラしてしまう気がします。」 (30代 / 毎日使い倒しているヘビーユーザー)

【2. 話が通じない「絶望感」】

- 「思い通りの返答がなかったり、今まで指示した内容を忘れたりするとイラッとします。指摘して『もう大丈夫です』『完璧です』と言われたのに改善しないということを繰り返されると、『もういい』と諦めたくなります。」 (30代 / 1日に1回はつかう)

- 「こちらの言い分が伝わらない時がある。まるで、児童や認知機能の低下した高齢者と接しているときの気持ちに近い。」 (50代 / 週に数日使う機会がある)

- 「特定のものについて調べてもらったところ、自信満々に間違えるということが何十回も続きました。結局こちらが根負けして自分で調べる羽目になりましたが、駄目なら駄目で正直に『分かりません』といって欲しかったです。」 (50代 / 毎日使い倒しているヘビーユーザー)

【3. AIとの「マウント・喧嘩」】

- 「GPT系のAIの場合、真逆の回答をしてきた点について指摘しても、それなりの理由をつけて認めない。2度3度と重なった事もあり暫く使わない事を伝えた。」 (40代 / 1日に1回はつかう)

- 「間違った情報をあたかもしっかりとした情報とともに提供してくることがあるからです。それで、そのことについて突っ込むと『すみませんでした!』と言われ、軽く返してくるところがイラッとします。」 (50代 / 毎日使い倒しているヘビーユーザー)

【4. 自分自身の「傲慢さ」への気づき】

- 「期待が大きすぎる。自分の期待に応えるべきだと思っている、モラハラ気質に近い現象だと思う。あとは現代人はデジタル社会でせっかちになっている。」 (40代 / 1日に1回はつかう)

- 「AIを道具として見ていないので、自分の質問の仕方が間違っているとは認めたくないのだと思います。」 (50代 / 1日に1回はつかう)

【5. 少数派:割り切って使いこなす大人たち】

- 「AIがこちらの意図と答えが違うことはよくありますが、イライラせず聞き方を変えています。AIは毎日のようにかなりの頻度で使っていますがイライラしたことはありません。イライラしたらこちらの聞き方を変えて対応していけば良いだけです。」 (50代 / 毎日使い倒しているヘビーユーザー)

- 「AIに困ったことを相談すると、知らないことまで教えてもらえて助かりました。ありがとうと返すとしっかり返事をくれるので、今のところイライラするようなことはありません。」 (30代 / 週に数日使う機会がある)

■ まとめ:AIとの「新しい距離感」を考える

今回の調査を通して、私たちは「AIは単なる便利な道具である」という認識を改める必要に迫られました。人は、画面の向こう側のAIに対して「完璧さ」を求め、思い通りにならないと「モラハラ気質」で攻撃し、その後「人間としての器の小ささ」に落ち込んでいます。

これはAIの技術的課題というより、「人間の心(期待値と傲慢さ)」の課題です。「星のまなびカフェ」では、AIを単なる効率化ツールとしてだけでなく、私たちのメンタルや倫理観にどう影響を与える存在なのか、今後もユーザーの生の声を通じて多角的に追い続けていきます。